Kilka dni temu na niebie obserwowaliśmy niezwykłe zjawisko, a w raz z nim pojawiły się fałszywe zdjęcia zaćmienia Słońca. Prawdopodobnie było ich nawet więcej niż tych prawdziwych. Podpowiem jak je rozpoznać?

Jak wyglądają fałszywe zdjęcia zaćmienia Słońca?

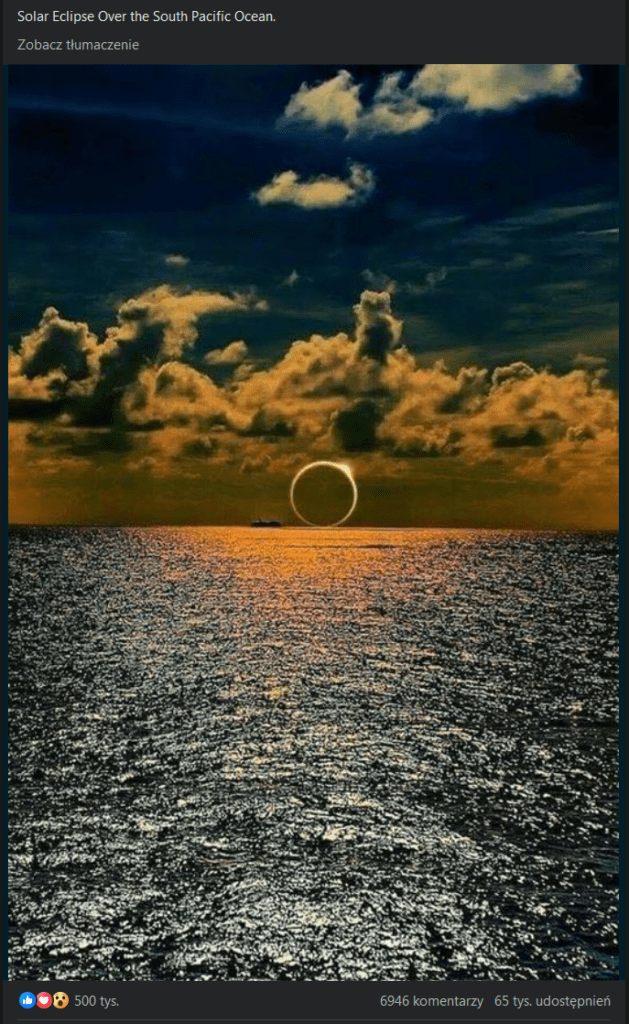

Poniżej możecie zobaczyć fejka, stworzonego nawet nie przez sztuczną inteligencję, ale w najprostszy możliwy sposób, w fotoszopie. Zdjęcie pojawiło się na dziesiątkach profili, a zasięgi jakie uzyskało były wręcz szokujące.

W tylko jednym z miejsc, gdzie się pojawiło polubiło je ponad… 500.000 ludzi. Oczywiście wiadomo, że nie był to zasięg organiczny tylko płatna promocja, ale mimo wszystko. Zdjęcie widziałem jeszcze na co najmniej kilku innych profilach i na każdym z nich było co najmniej kilkadziesiąt tysięcy polubień.

Jak rozpoznać fałszywe zdjęcia zaćmienia Słońca?

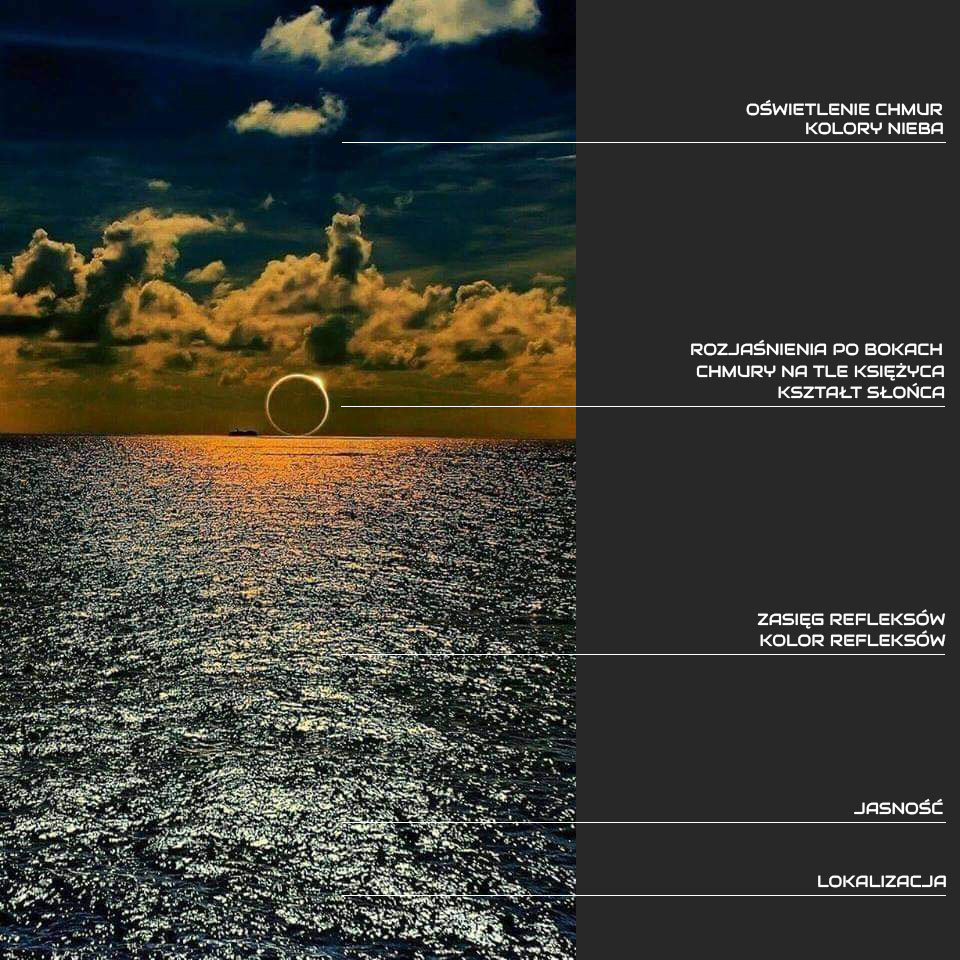

Poniżej oznaczyłem główne elementy, na które powinniście zwrócić uwagę.

A co dokładnie na zdjęciu jest nie tak? Po kolei od góry:

- chmury na obrazku oświetlone są od góry – co miałoby je stamtąd oświetlić?

- niebo i chmury są dwukolorowe dół ciepłe barwy, góra zimne, nie ma żadnego pojedynczego źródła światła, które byłoby wstanie tak oświetlić niebo

- słońce na horyzoncie ma kształt idealnego koła, takie coś nie występuje, moment w którym widzimy słońce tuż nad horyzontem to faktycznie ono jest już kilka stopni poniżej niego i nie zagłębiając się w fizykę – ma kształt bardziej elipsy niż koła

- nad horyzontem widać chmury, które są na wysokości słońca, którego nie przesłaniają, ale jednocześnie przesłaniając kontrastowy księżyc

- niebo pod chmurami – obok słońca – jest ciemniejsze niż na krawędziach obrazka

- zasięg refleksów na wodzie jest taki, że musiały powstać od czegoś co jest wysoko na niebie a nie na samym horyzoncie

- refleksy na wodzie są w dwóch kolorach – ta sama sytuacja co przy chmurach, jedno źródło światła nie może dać dwóch różnych barw

- jasność – góra obrazka jest znacznie ciemniejsza niż dół

- lokalizacja – w podpisie było, że to jest zaćmienie nad Pacyfikiem – w czasie, gdy rozpoczynało się zaćmienie nad oceanem słońce było wysoko na niebie

No i na koniec, choć może od tego powinienem zacząć, na obrazku jest dorobiony okrąg imitujący zaćmienie, a nie przesłonięta czymś tarcza słoneczna.

Prawdziwe zdjęcie zaćmienia słońca

Takich też jest sporo, choć zwykle nie są tak spektakularne jak te stworzone przez AI. Wyjątkowym przykładem jest tutaj zdjęcie zrobione przez Petera McKinnona na zlecenie Red Bulla. Już to jaka firma zamówiła zdjęcie gwarantowało, ze pomysł będzie naprawdę wyjątkowy.

I taki był! Sam fotograf określił efekt jako najlepsze zdjęcie jakie zrobił dotąd w swoim życiu.

Przygotowania do wykonania zdjęcia trwały kilka tygodni. Polegały przede wszystkim na tym by wykonać masę obliczeń gdzie fotograf i samoloty Red Bulla będą się musiały znaleźć w bardzo precyzyjnie określonym czasie. A precyzja musiała być naprawdę niesamowita bo by taki kadr mógł się zdarzyć samoloty musiały nadlecieć we właściwe miejsce praktycznie co do sekundy. I jak widać udało się.

Efekt robi niesamowite wrażenie. I gdyby nie pewność co do jego realnego wykonania to także tutaj można by było podejrzewać sztuczną inteligencję o wygenerowanie zdjęcia.

Na kanale Petera możecie poznać nieco więcej szczegółów dotyczących powstawania zdjęcia.

Jeszcze więcej fejków z popularnych miejsc

Ale to oczywiście nie było jednorazowe wydarzenie. Każdego tygodnia, a nawet dnia dzieją się różne rzeczy, które są wykorzystywane do generowania za pomocą sztucznej inteligencji nieistniejących treści. Lub po prostu fałszywych obrazów realnych miejsc.

Dopiero co mieliśmy do czynienia z ulewą w Dubaju, jak myślicie co od razu zaczęło być generowane za pośrednictwem AI? Tego oczywiście już łatwo się domyślić.

Oglądając niektóre fanpejdże na facebooku można zauważyć, że nie ma tam w ogóle zdjęć, tylko obrazy generowane przez sztuczną inteligencję. Dotyczą one szczególnie popularnych miejsc, takich jak choćby Nowy Jork.

Patrząc na to co się dzieje obecnie w social mediach wydaje się, że już za kilka miesięcy, może rok, obrazy generowane przez AI będą takiej jakości, że naprawdę trudno będzie je odróżnić od rzeczywistości. I będzie ich prawdopodobnie więcej niż prawdziwych zdjęć. Być może będą wstanie odróżnić je wyłącznie osoby, które osobiście znają miejsca na tych obrazach przedstawione.

I tak jak na przykładzie rzekomego zdjęcia powyżej przedstawiającego Statuę Wolności – każdy kto był w Nowym Jorku wie, że nie ma za nią takiego mostu jaki tam widać. I wie o tym, że to co dalej to zdecydowanie nie jest panorama Manhattanu. Ale niestety większość oglądających nie ma o tym pojęcia i polubi post podbijając jego zasięgi.

W poście zostało użyte tylko jedno prawdziwe zdjęcie – to które zrobił Peter McKinnon, wszystkie pozostałe obrazy zostały wygenerowane przez sztuczną inteligencję.